구글이 출시한 인공지능 챗봇 바드(Bard)에 자사 직원들이 의문을 제기하고 나섰다.

거대언어모델(LLM)을 기반으로 한 바드의 유용성을 신뢰할 수 없다는 것이다.

블룸버그는 11일(현지시간) 바드 전용 디스코드에 올라온 개발자 논의 내용을 캡처해 보도했다.

후원

후원

바드의 사용자 경험 책임자 캐시 펄은 “LLM이 정말 유용하게 사용될 수 있는 곳은 어디일지에 관해 끊임일까 고민하고 있다”며 “아직은 찾지 못한 것 같다”고 언급했다.

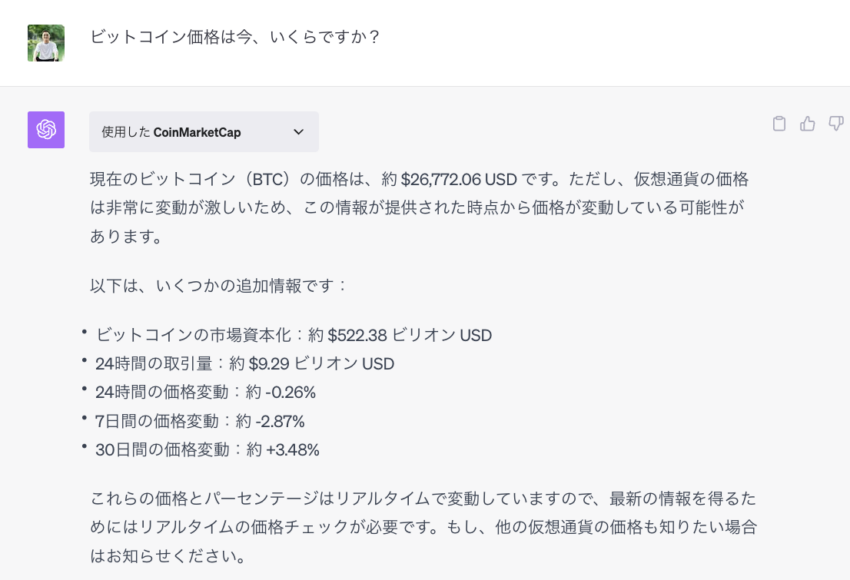

유용성에 대한 부분은 비단 개발자들만의 고민이 아니다. 커뮤니티 회원들은 바드가 기본적인 질문에도 대답하지 못한다고 지적한다. 최근 엑스(X, 옛 트위터)에도 비슷한 글이 올라왔다.

“바드를 사용해본 사람이라면 누구나 동의할 것이다. 구글의 자체 앱이 어떻게 작동하는지에 대한 기본적인 질문(예: 애널리틱스, 보안 문자 등)에도 답하지 못한다. 테스트해 보라.”

신뢰도 문제도 불거졌다. 바드의 제품 관리자 도미니크 라비예는 “LLM은 사용자가 직접 검증하지 않고는 그 결과를 신뢰할 수 없는 상황”이라고 토로했다.

“바드는 브레인스토밍 목적으로 사용하는 게 이상적이다. 바드가 산출하는 데이터는 온전히 신뢰할 수 없다.”